Konec oktobra je v Ljubljani potekala konferenca DISCO, ki je združila tako tuje kot domače govorke in govorce, strokovnjakinje in strokovnjake ter gostje in goste iz prakse, ki so obravnavali prevladujoče poglede na tehnološki napredek in se pogovarjali o tem, kako razviti boljše tehnologije za vse. Pred naš mikrofon smo povabili tri sogovornice. Kako o digitalni suverenosti razmišljajo pravnica iz Poljske, ki se bojuje proti spletnim gigantom, raziskovalka iz Združenega kraljestva, ki se ukvarja z vprašanjem etične rabe tehnologij umetne inteligence, in študentka političnih ved, ki je egiptovsko revolucijo na Trgu Tahrir opazovala iz svoje otroške sobe?

Dorota Anna Glowacka je odvetnica, ki deluje pri Fundaciji Panoptykon. Gre za nevladno organizacijo, ki se zavzema za digitalne pravice, s sedežem v Varšavi na Poljskem. Z odvetnico smo se pogovarjali o tem, kako poteka pravni boj s spletnimi giganti. Obstaja veliko različnih metod, vendar boj nikakor ni lahek, saj gre očitno za veliko neskladje med viri, ki jih imajo nevladne organizacije, in tistimi, ki jih imajo velika globalna podjetja. Sogovornica je poudarila, da je treba biti pameten in znati uporabiti svoje omejene vire kar najbolje. "Eden izmed načinov, kako to narediti, so tako imenovani strateški sodni postopki. To pomeni, da se s podjetji soočiš pred sodiščem, zmaga pa ni nujno cilj sam po sebi. Ideja je, da s tožbo postaviš standarde, ki bodo tako učinkovali na več ljudi." Kot je pojasnila, je cilj soočenja na sodišču bolj sistemska sprememba nekaterih praks ali regulative.

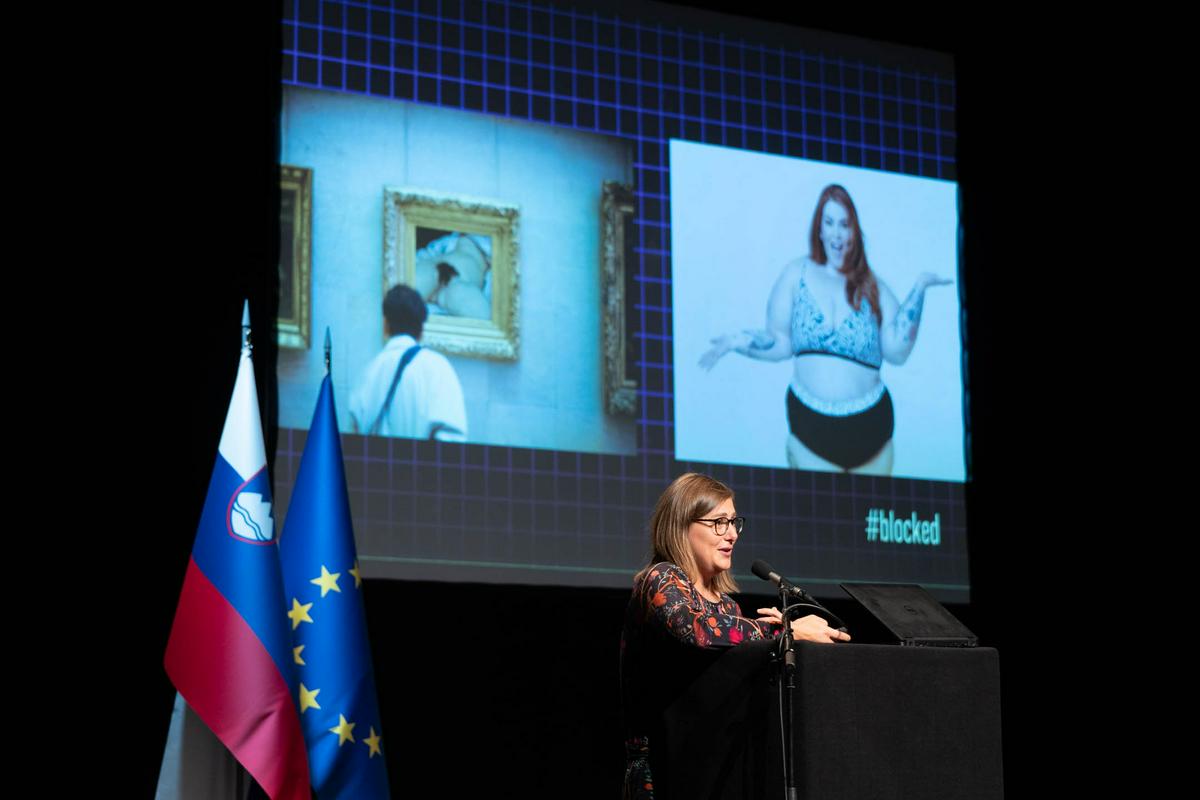

Cenzura profilov na družbenih omrežjih je netransparentna

Eden izmed primerov, s katerim se ukvarjajo pri Fundaciji Panoptykon, je cenzura zasebnih profilov. Gre za prakso, ko velike platfome odstranijo neko vsebino ali celo posamezen račun. Ob tem uporabnici ali uporabniku ne pojasnijo, zakaj so to naredili, hkrati pa tudi ne dopuščajo možnosti preizpraševanja te odločitve. Glowacka pravi, da bi "radi spremenili to prakso, ko se odločitve o moderiranju vsebine sprejema zelo netransparentno in arbitrarno, saj je to grožnja sodobnemu svetu in svobodi izražanja". Velika tehnološka podjetja po njenem namreč ne bi smela imeti tako izjemne moči nad informacijskimi tokovi.

Boj proti obstoječim gigantom ali ustvarjanje novih, ki bi delovali kot javne storitve?

Družbene medije ljudje po večini razumejo in uporabljajo kot javne storitve, čeprav gre za zasebna podjetja, ki imajo na trgu kvazimonopol. Sogovornica pojasnjuje, da se zelo zanašajo na "net effect" oziroma mrežni učinek, to pomeni, da so ljudje od teh platform odvisni. "Dopustili smo, da so tako zrasle, da je zdaj res težko narediti korak nazaj in se s platform umakniti. Številni resnično nimajo več te izbire. Dobro, v teoriji izbira še vedno obstaja, saj ni obvezno imeti svojega računa tam, ampak tako veliko ljudi to uporablja, da ostajajo v stiku s svojimi prijatelji, uporabljajo ga za delo, saj vedo, da so te priljubljene platforme kanal, prek katerega so lahko v stiku s svojimi strankami. Torej, saj veste, ljudje ostajajo tam, kjer so drugi ljudje. Mrežni učinek je težko razbiti." Sogovornica sicer upa, da se bodo razvile alternative s poslovnimi modeli, ki jim ne gre le za dobiček, ampak za javno dobro, za zdaj pa je po njenem mnenju pomembno, da se bojujemo proti sedanjim igralcem in jih poskušamo prisiliti, da se vedejo drugače, manj škodljivo.

Spletni giganti morajo spoštovati novo evropsko regulacijo

Kar bi definitivno pomagalo pri tem procesu, je velik družbeni pritisk, tako na platforme kot na odločevalce, da svoje delo opravijo, kot je treba. Mislim, da kot družba še lahko kaj rečemo in delno tudi vplivamo na proces, tako da izvajamo družbeni pritisk na oba akterja.

Ko govorimo o transparentnosti družbenih medijev kot osrednji točki digitalne suverenosti, ne moremo mimo žvižgačk in žvižgačev, ki so v preteklosti razkrili tisto, kar smo sicer slutili, da se dogaja, nismo pa si mislili, da gre za namerno povzročene učinke. Frances Haugen je med drugim razkrila recimo škodljive učinke na duševno zdravje deklet, saj to gigantu Meta prinaša večji dobiček. Sogovornica pravi, da je bil prispevek žvižgačk in žvižgačev ključen, saj je imel učinek na odločevalce, ki so sprevideli, da je potrebna strožja regulacija. "Pred tem smo imeli drugačne strategije – politika se je pogajala s platformami, dogovorili so se za nekakšno samoregulacijo in kodekse ravnanja, ampak to ni bilo dovolj. Vendarle so potem odločevalci, še posebni na ravni Evropske unije, sklenili, da potrebujemo strožjo regulacijo, ki so jo lani sprejeli." Akt o digitalnih storitvah omejuje velike igralce na internetu, najbolj pa največje med njimi. Zakonodaja je v celoti začela veljati 25. avgusta. Dorota Anna Glowacka opozarja, da bo zdaj ključna stvar njeno učinkovito uveljavljanje, "to pa je po eni strani odvisno od tega, kako resno bodo platforme pristopile k tej zakonodaji in kako resno jo bodo implementirale. Po drugi strani pa, koliko bo Evropska komisija sposobna izvajati pritisk in poskrbela, da bo njena vloga nadzornega organa učinkovita."

Akt o umetni inteligenci bo treba tudi implementirati

Eleanor Drage je raziskovalka na Univerzi v Cambridgeu, kjer se ukvarja z etiko umetne inteligence. Po njenem mnenju brexit pomeni, da Združeno kraljestvo nazaduje pri skrbi za boljše tehnologije v primerjavi z Evropsko unije, razlike pa se bodo samo še povečevale. Akt o umetni inteligenci, ki ga pripravlja Evropska unija, zavzema na tveganju utemeljen pristop. Oblikovala je tri glavne kategorije: v prvi so prepovedane prakse, ki pomenijo nesprejemljivo tveganje, v drugi sistemi, ki pomenijo visoko tveganje, in v tretji sistemi z majhnim tveganjem. Ker obveznosti niso dobro definirane in so precej dvoumne, sogovornica soustvarja komplet orodij za soočanje z evropskim aktom o umetni inteligenci. »Izhajam iz feminističnih in protirasističnih teorij in idej, zato želimo torej obogatiti akt o umetni inteligenci s temi idejami. Da bodo lahko podjetja, ki jim je resnično mar za ustvarjanje dobrega v tem svetu, izpolnila obveznosti, opravila revizijo in pravilno izpolnila vse dokumente, hkrati pa bodo lahko svojo tehnologijo usmerila k pravičnosti,« pojasnjuje Elenor Drage, ki upa, da bo nekega dne vsa umetna inteligenca postala dolgočasna, saj bo to pomenilo, da ni problematičnih rab, ljudem se ne bo treba upirati in nasprotovati.

Umetna inteligenca je škodljiva že danes, predvsem za tiste, ki niso beli moški

Digitalna suverenost po mojem mnenju pomeni lastništvo, izbiro, soglasje glede uporabe osebnih podatkov. To ni nekaj, kar bi nam bilo dano od vlad ali tehnoloških podjetij. Na žalost gre torej za nekaj, kar moramo zahtevati nazaj. Podatkovna ali digitalna suverenost zato meni pomeni tudi upor, skupnost, solidarnost, postavljanje zase, ustvarjalno inženirstvo z radikalnimi inženirkami in inženirji.

Strahovi, ki jih slišimo v povezavi z umetno inteligenco za prihodnost, izvirajo iz znanstvene fantastike in ne iz resničnih škodljivih rab. Težavo nam predstavljajo podatki, za katere se predvideva, da so točni in objektivni. To pa ne drži. Še posebno, če gledamo z zornega kot spola in rase. Sogovornica na Cambridgeu v okviru svojega raziskovalnega laboratorija pripravlja tudi podkast The Good Robot. V njem je pred kratkim gostila Meredith Broussard, utemeljiteljico tehnošovinizma, ki je umetno inteligenco preimenovala v umetno neinteligenco, saj je vanjo vgrajenih preveč pristranskosti, binarnosti in napak. Tako kot bo v medicini in farmaciji drago in težko odpraviti raziskovalne napake, ki jih je povzročilo raziskovanje izključno biološko moških osebkov, saj nimajo menstruacijskega cikla, ki raziskovanje oteži, podraži in podaljša, bo to težko tudi v digitalni sferi. Računalniška koda namreč temelji na binarnem sistemu, v katerega je vpisan spol. Eleanor Drage pa ob tem opozarja, da moramo biti previdni, ko skušamo pristranskosti odpraviti, saj moramo najprej razmisliti, kaj sploh hočemo popraviti. "Na primer zbirka podatkov, ki sta jo ustvarili odlični raziskovalki Temnit Gebru in Joy Buolamwini. Šlo je za projekt Gender Shades, Sence spola, ki se je želel bojevati proti manku podatkov o obrazih črnskih žensk v zbirkah podatkov. Ta manko podatkov je na primer pomenil, da je umetna inteligenca za prepoznavanje obrazov črnske ženske najpogosteje napačno identificirala. Njuna zbirka podatkov je tako izboljšala prepoznavanje obrazov črnih žensk, vendar so zato postale pogostejše tarče nadzora z umetno inteligenco," kot primer navede sogovornica.

Prostor svobode se je sprevrgel v prostor nadzora

Potem ko smo se še pred leti čudili filmu The Social Dilema, v katerem so kot največjo nevarnost družbenih medijev predstavili zasvojenost in ne polarizacije, radikalizacije ter krhanja demokracije, danes razumemo, da gre za dve strani istega kovanca. Ljudi, ki ne morejo pustiti svojega telefona pri miru in ves čas na tem ali onem družbenem omrežju preverjajo objave, je tudi pri nas vse več. Zato se je tudi naš odnos do novih tehnologij spremenil. Vemo, da so škodljive, ampak jih, tako kot sladkor in alkohol, ne zmoremo konzumirati zmerno. V šolah se zato z otroki o internetu in spletu pogovarjamo predvsem na negativen način. Predstavljamo jim torej vse stvari, ki so nevarne, ki jim lahko škodijo. Učimo jih, kako se zaščititi, od pametnih telefonov in družbenih medijev jih želimo držati čim dlje. To pa jim pravzaprav tudi odvzema svobodo, prostor izražanja in povezovanja.

Alia ElKattan je doma iz Egipta, rodila se je v Kairu in tam tudi odraščala, zdaj živi v New Yorku, v Brooklynu, kjer je doktorska študentka na Univerzi v New Yorku. Študira politične znanosti, prej pa je študirala računalništvo. Dela torej na presečišču tehnologije in politike, raziskuje pa učinke družbenih medijev na to, kako se o politiki učimo in kako jo živimo v praksi. Poleg tega sodeluje pri različnih izobraževalnih projektih, ki vpliv tehnologije na družbo predstavljajo na poljudnejši, do uporabnic in uporabnikov prijaznejši način. Ustvarja interaktivne spletne strani in računalniške igre, da je učenje zabavnejše, dostopnejše in vključujoče za večje občinstvo. Ena izmed iger, ki jo je pripravila s svojimi prijateljicami in prijatelji, se imenuje Survival of the Best Fit. Njeno raziskovanje presečišča politike in družbenih medijev ni naključno, saj je odraščala med revolucijo v Egiptu. "Odrasla sem na Trgu Tahrir v Egiptu, kjer se je začela revolucija. Ta trg je bil središče arabske pomladi. Takrat sem imela dvanajst let, revolucijo sem slišala in videla z okna svoje otroške sobe. Na trgu smo videli napise, kot je na primer: Hvala, Twitter, hvala, Facebook. Takrat sem si ustvarila profil na Twitterju, februarja 2011, vsak dan sem objavljala na Facebooku, mislila sem, da sem ena izmed civilnih novinark, ampak moje objave je videlo šest mojih prijateljic in prijateljev, jaz pa sem objavljala: tole se prav zdaj dogaja na Tahrirju, prvi vir." Pravi, da je ves svet družbene medije imel za orodje, ki ljudem prinaša demokracijo in podpira svobodo izražanja. Po njenem je šlo bolj za pravi tajming kot kaj drugega. Ti režimi niso bili pripravljeni na to, da se bodo ljudje prek družbenih medijev mobilizirali.

Je pot v pogubo tlakovana z dobrimi nameni ali z željo po čim večjem dobičku?

Družbeni mediji se danes uporabljajo drugače, za krepitev represije, širjenje laži in dezinformacij, za manipulacijo, polarizacijo in radikalizacijo. Namesto da bi bili družbeni mediji orodje za samoizražanje, so postali orodje za nadaljnjo represijo in cenzuro, pravi sogovornica in priznava, da "del mene, ki se je na družbenih medijih naučil izražati svoja politična stališča, na to ne želi torej gledati le s tega zornega kota in želi priznati, da je zame to še vedno edini prostor, kjer lahko izrazim kakršne koli politične misli. Zdaj spremljam, kar se dogaja v Palestini, ki je sosednja država moje države. Na Twitterju pa Palestinke in Palestinci v živo objavljajo svoje zadnje trenutke na tem svetu. Ljudje so objavljali svoje zadnje objave, tik preden so jih bombardirali. Samo na Twitterju sem to videla."

Po njenem ne gre torej za vprašanje, ali bi morali imeti družbene medije ali ne, ampak za to, kako imeti take družbene medije, ki se bodo zavzemali za svobodo govora in bodo ščitili ljudi. Kot civilna družba moramo po njenem ugotoviti, kako vse to na varen način doseči.

Le nekaj spletnih gigantov nadzira naša spletna življenja, zato se pač ukvarjajo z zahtevami po dobičku in poslovnimi modeli. Alia pravi, da je težko torej zahtevati od podjetij, da se "pravilno odločijo", če pa taka odločitev ne prinese največ denarja. "Prepričana sem, da je veliko zaposlenih pri spletnih gigantih, ki imajo močna prepričanja o svojih izdelkih in si želijo ustvarjati zdrave in varne izdelke, ampak to enostavno ne prinese največ denarja. Mislim, da potrebujemo regulacijo, ki bo nadzorovala velikost teh platform in kolikšen del interneta si lahko lastijo."

Kulturno raznolikost je treba sprejeti, razumeti in upoštevati

Preveč se ukvarjamo z napačnimi skrbmi. Veliko govora o umetni inteligenci se navdihuje iz znanstvene fantastike. O njej torej govorijo tipi, ki so gledali take filme, igrali take računalniške igre in odločajo o naši prihodnosti. Zato pa spregledujemo resnično škodo, ki nam jo že danes povzroča umetna inteligenca. Na primer uporaba prepoznavanja obrazov za nadzor, uporaba algoritmov pri sprejemanju odločitev o tem, kdo dobi zdravstveno ali socialno pomoč, za koga se napoveduje, da bo uspel pri izobraževanju, kdo gre lahko iz zapora ali kar koli.

Največja podjetja izvirajo iz Združenih držav Amerike, zato prevzemajo ameriško politiko, standarde in pristranskosti. Alia pravi, da se lahko na različne načine prilagodiš različnim kulturam le takrat, ko se ljudje v različnih državah lahko samostojno odločajo pri razvojnem procesu, če lahko soodločajo o tem, kateri izdelki so in kateri niso primerni zanje. »Ni treba, da gre za zelo kontroverzne stvari, lahko je enostavno stvar jezika – nekatere stvari recimo v arabščini ne delujejo.« Kot pojasnjuje, ljudi, ki objavljajo v arabščini, pogosteje cenzurirajo, saj algoritmi niso tako dobri in vanje nihče ne investira. Ob tem navede primer Instagrama, ki je nepravilno prevajal osebne opise uporabnic in uporabnikov. »Mislim, da je šlo za izraz: ham du allah, ki v arabščini pomeni: hvala bogu. To veliko ljudi vključi v svoj opis, recimo hvala bogu za vse. Če pa si bil v Palestini, se je to avtomatično prevedlo v besedo: terorist. In potem je Instagram pač naključne otroke označeval za teroriste.« Alia poudarja da se te stvari dogajajo, ker spletni giganti ne investirajo dovolj v te druge jezike, čeprav so na teh platformah res velike populacije ljudi, ki jih uporabljajo.

Podoben opis jezikovnih težav najdemo tudi ob primeru vpliva Facebooka na genocid v Mjanmaru, ki ga je med drugim opisal tudi Charles Arthur v knjigi Social Warming. Te težave, ki jih imamo s tehnologijo danes, z razvojem umetne inteligence ne bodo izginile, temveč se bodo samo še poglobile. Zato moramo zahtevati večjo transparentnost, odprtost, vključevanje, izobraževanje in boljše tehnologije za vse.

Komentarji so trenutno privzeto izklopljeni. V nastavitvah si jih lahko omogočite. Za prikaz možnosti nastavitev kliknite na ikono vašega profila v zgornjem desnem kotu zaslona.

Prikaži komentarje